Miguel Huerta

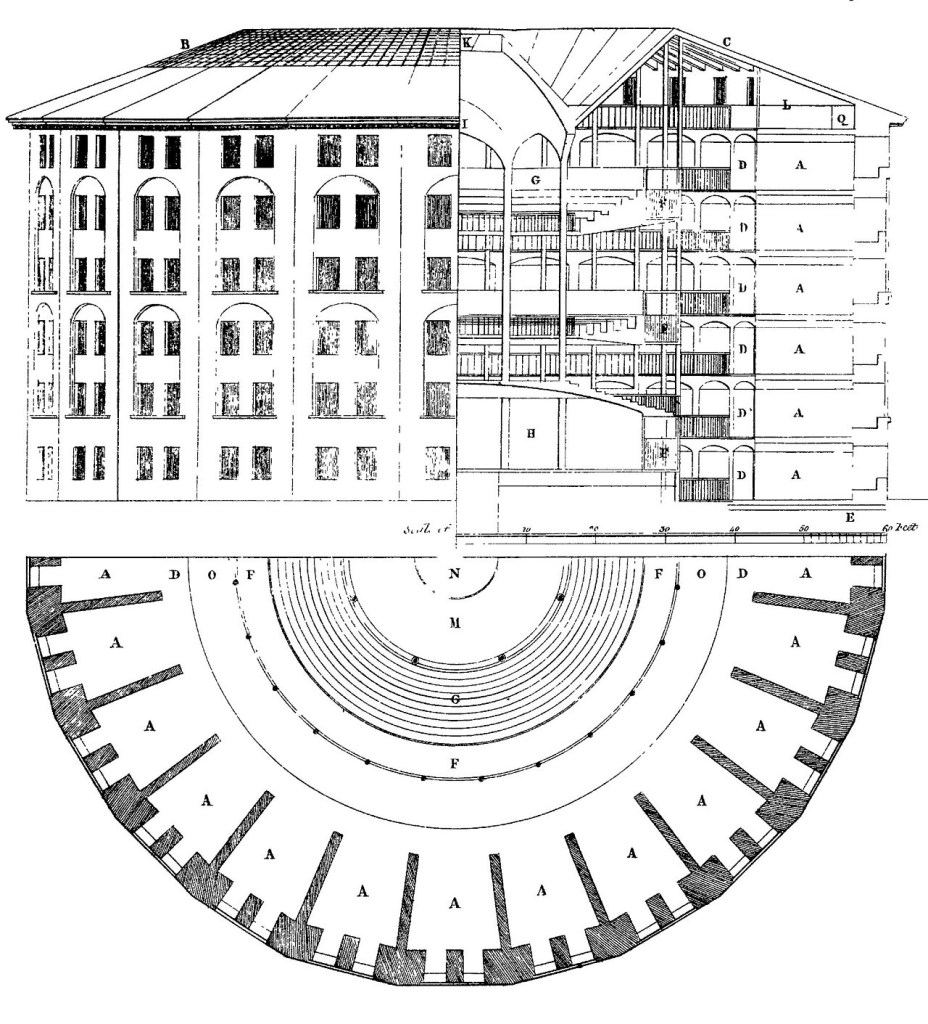

Jeremy Bentham concibió a finales del siglo XVIII la estructura arquitectónica del Panóptico, sin embargo, difícilmente podía imaginar que su idea de una prisión circular con una torre central de vigilancia se convertiría, dos siglos después, en la metáfora más precisa para describir el funcionamiento de las sociedades digitales.

Michel Foucault rescató esta figura para explicar cómo la mera posibilidad de ser observado (la internalización de la mirada del vigilante) disciplina los cuerpos y normaliza las conductas en la modernidad. Hoy, esa torre de vigilancia ya no necesita ser de piedra ni tener un vigía humano; se ha vuelto intangible, ubicua y, sobre todo, algorítmica. Empresas como Palantir Technologies encarnan la realización más perfecta y aterradora de este sueño disciplinario: un panóptico digital donde la vigilancia ya no se limita a corregir conductas visibles, sino que aspira a predecirlas, modelarlas y gobernarlas desde la más absoluta opacidad.

Lo que distingue a este nuevo panóptico digital de sus predecesores no es únicamente su escala, sino su naturaleza ontológica. Mientras que el panóptico clásico se observaban cuerpos en un espacio delimitado (la prisión, la fábrica, el hospital, la escuela), el panóptico de Palantir observa datos, y al hacerlo, construye una realidad paralela que termina por imponerse sobre la física. Sus plataformas Gotham y Foundry no se limitan a almacenar información; integran bases de datos dispares, desde registros migratorios y transacciones financieras hasta publicaciones en redes sociales y movimientos de tropas, para crear lo que la empresa denomina una “ontología digital”: un gemelo virtual del mundo sobre el cual los algoritmos pueden operar.

La consecuencia ética es devastadora, pues cuando un sistema de inteligencia artificial, alimentado por estos datos, determina qué inmigrantes son “sospechosos” o qué barrios merecen más vigilancia policial, no está interpretando la realidad, sino creando una nueva versión de ella que, al ser ejecutada por instituciones con poder coercitivo, se ha vuelto literalmente inapelable.

La crítica filosófica se vuelve urgente al constatar que este panóptico carece de la característica que, paradójicamente, hacía soportable al original: la simetría de la mirada. En el diseño de Bentham, la torre central estaba abierta a la inspección pública, garantizando que el poder mismo pudiera ser vigilado. En el caso de Palantir, sin embargo, el secreto corporativo y la clasificación gubernamental blindan los algoritmos de cualquier escrutinio democrático. Cuando el Ministerio de Defensa de España adjudica contratos millonarios a la empresa bajo la figura de “exclusividad técnica”, o cuando la policía alemana utiliza su software sin que los ciudadanos puedan conocer los criterios de sus evaluaciones, nos encontramos ante lo que podríamos denominar una “caja negra del poder”. No sabemos qué fórmulas y estadísticas se asignan a determinadas variables, ni cómo se construyen los perfiles de riesgo, ni, lo más grave, ante qué sesgos estamos siendo discriminados. La opacidad algorítmica no es un defecto técnico subsanable; es una característica estructural que convierte a estas empresas en soberanas de un territorio sin ley.

Esta situación adquiere contornos trágicos cuando examinamos las aplicaciones concretas de esta tecnología. El caso de la colaboración de Palantir con el Servicio de Inmigración y Control de Aduanas de Estados Unidos (ICE) es paradigmático. El desarrollo de herramientas como “ImmigrationOS” no se limita a agilizar trámites burocráticos, sino que integra datos de redes sociales, historiales laborales y patrones de movilidad para priorizar deportaciones con una “eficiencia” que ningún ser humano podría alcanzar. Desde una perspectiva kantiana, esto constituye una violación sistemática del principio de dignidad humana, pues las personas son tratadas no como fines en sí mismas, sino como meros datos cuya trayectoria puede ser optimizada para cumplir objetivos gubernamentales. El imperativo categórico de no utilizar al ser humano como medio encuentra aquí su negación más absoluta, ya que en nombre de la seguridad o la eficiencia, se construyen perfiles a los que la persona no tiene conocimiento y contra los que no puede apelar.

La responsabilidad del filósofo ante este panorama no puede limitarse al diagnóstico pesimista. Si algo nos enseñó Hannah Arendt acerca de la banalidad del mal es que los sistemas más atroces se sostienen sobre la base de pequeños actos de delegación acrítica. Por eso, la resistencia al panóptico digital debe comenzar por una vigilancia epistemológica constante: preguntar siempre quién recopila los datos, con qué fines, bajo qué salvaguardas y, sobre todo, quién vigila a los vigilantes. Como usuarios de tecnología, como ciudadanos y como intelectuales, tenemos la obligación de desconfiar de los discursos que presentan la eficiencia algorítmica como un valor neutral. La eficiencia sin ética no es progreso, sino totalitarismo de baja intensidad. Cuando Palantir afirma que su misión es proteger “a los aliados de Occidente”, deberíamos preguntarnos si Occidente no estará sacrificando precisamente aquello que dice defender: la transparencia, el debido proceso y la presunción de inocencia.

Quizá el gesto más revolucionario que podemos oponer a este panóptico algorítmico sea, precisamente, la recuperación de la opacidad humana. Frente a la exigencia de transparencia total que los sistemas de datos imponen (donde todo debe ser cuantificado, registrado y predicho), tal vez debamos reivindicar el derecho a no ser completamente inteligibles, a mantener un resto de misterio que escape a la clasificación algorítmica. Como recordaba el filósofo Byung-Chul Han, la sociedad de la transparencia produce sujetos sin interioridad, meras superficies de datos expuestas a la mirada del poder. En ese sentido, oponerse a empresas como Palantir no es solo una cuestión de privacidad, entendida como protección de datos personales; es una lucha por la preservación de lo humano como aquello que, por definición, nunca puede ser completamente capturado por ningún algoritmo. Porque si algo distingue a la conciencia de un simple procesamiento de información es precisamente su capacidad para guardar silencio, para ocultarse, para no estar disponible. Defender ese silencio frente al ruido ensordecedor de los datos es, hoy, la más urgente de las tareas filosóficas.

Para seguir ahondando en esta reflexión, quizá convendría que, como lectorxs y como ciudadanxs, nos hiciéramos algunas preguntas incómodas. ¿Hasta qué punto nuestra comodidad cotidiana (la navegación GPS que nos ahorra tiempo, la recomendación algorítmica que nos entretiene) justifica ceder el mapa completo de nuestra vida a corporaciones cuya lealtad última es con el accionista, no con el ciudadano? ¿Qué tipo de libertad podemos reclamar cuando nuestras decisiones ya han sido anticipadas, clasificadas y, en cierto modo, decididas por un modelo predictivo que nos conoce mejor que nosotros mismos? ¿Y si el verdadero lujo del siglo XXI no consistiera en acumular más dispositivos inteligentes, sino en poder vivir sin ser permanentemente inteligibles para el poder? Cuando aceptamos que la seguridad o la eficiencia exigen la disolución de todo secreto, ¿no estaremos construyendo, sin saberlo, una cárcel de cristal donde la única privacidad posible sea la que nos conceda discrecionalmente el vigilante? Finalmente, si la función de la filosofía es, como querían los antiguos, enseñarnos a vivir bien, ¿no debería hoy enseñarnos también a desaparecer un poco, a sustraernos de la mirada algorítmica, a reclamar ese pequeño espacio de opacidad donde lo humano pueda aún acontecer sin ser registrado, medido y monetizado?

2026 – Acción Ética – Todos los derechos reservados. Este ensayo fue escrito con fines de reflexión y análisis.